Estamos hablando mucho del coche autónomo. El futuro del automóvil pasa ineludiblemente por coches en los que seremos simples pasajeros. Coches seguros, eficientes e inteligentes, que nos salvarán de los atascos y nos ahorrarán decenas de horas perdidas al año. Los primeros modos de conducción semi-autónoma en autopista ya se han estrenado, sin ir más lejos en el Mercedes GLC. Pero el coche autónomo tiene un reverso tenebroso que quizá desconocías. ¿Comprarías un coche que está programado para matarte si es necesario?

¿Va mi coche autónomo a atentar contra mi vida?

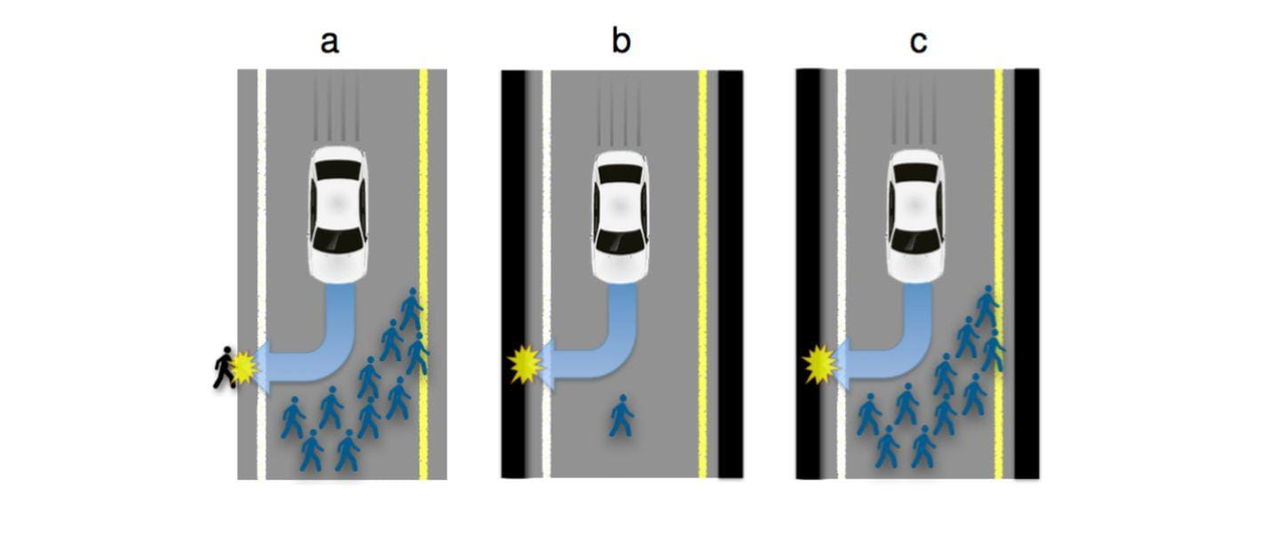

Estamos de acuerdo en que los accidentes son imprevisibles. Por muy seguro que pueda ser un coche autónomo, los accidentes aún pueden ocurrir. Imaginad que vuestro coche autónomo circula por una carretera secundaria y una moto fuera de control se dirige hacia tu coche, en una trayectoria de choque segura. Una trayectoria que posiblemente termine con la vida del motorista. ¿Debería el coche autónomo lanzarse por la cuneta si sabe que las posibilidades de supervivencia de los ocupantes del coche son muy superiores?

Es una decisión moral que deberá estar imprimida en el cerebro electrónico del coche. Una decisión muy compleja que el coche debe tomar en milisegundos, y que otorga al vehículo capacidades de razonamiento similares a las de un cerebro humano. Estamos de acuerdo en que esta es una decisión adecuada, así que aquí va otra. Imaginad que ocurre lo mismo, pero en una curva ciega a las afueras de un pueblo un grupo de niños ha salido corriendo a por una pelota y ocupan el centro de la carretera de forma inconsciente.

Es demasiado tarde para frenar, pero el coche tiene la opción de desviarse e impactar contra un muro al lado de la carretera. El choque acabaría con la vida del ocupante del coche autónomo, una sola persona en ese momento. El coche autónomo podría elegir acabar con tu vida en vez de con la vida de tres niños. Ahora bien, ¿sería diferente la decisión del coche si a bordo fuesen cinco ocupantes? Los accidentes serán poco comunes con un coche autónomo, pero aún pueden darse situaciones que escapen al control del coche.

Un interesante paper publicado por Jean-François Bonnefon hace unos meses para la Tolouse School of Economics pone de relieve los dilemas morales a los que el coche autónomo del futuro podría enfrentarse, y cómo debería solucionarlos. El paper está redactado en inglés, pero si te interesa mínimamente divulgar el futuro del coche autónomo, deberías leer al menos la introducción del estudio y las preguntas que plantea. Preguntas a las que alguien debe dar una respuesta, ya sea el fabricante del coche o una comisión gubernamental.

¿Pulgar arriba o pulgar abajo? Creando algoritmos morales

Son los algoritmos morales los que decidirán la actuación del coche ante imprevistos en los que vidas humanas corren riesgo. El paper postula que es la investigación estadística la que debe responder a estas preguntas, dando lugar a patrones morales de comportamiento. Patrones que reflejan la complejidad de las emociones humanas, modelizando acciones en muchos casos instintivas. ¿Terminarías con tu vida ante una situación como las anteriormente descritas? ¿Actuarían de igual manera todas las personas?

Los coches autónomos ya circulan por España, aunque siempre con un supervisor humano.

Comprendo que este artículo plantea más preguntas que respuestas, pero en última instancia, será el coche el que decida por nosotros. Incluso se llegan a plantear la preferencia del consumidor por un coche con un algoritmo moral que tienda más a preservar la vida de los ocupantes, frente a la de terceros. Por ello plantea la regulación gubernamental. Los mismos gobiernos que aún desconocen la tecnología del coche autónomo a este nivel de especificidad, y que van muy rezagados ante la iniciativa privada.

Mi opinión personal es que debería haber un «marco moral» unificado para el coche autónomo, idéntico para todos los coches del mercado capaz de conducir por sí mismos. El objetivo es crear una política común lo más justa para todos los usuarios de la vía pública. Alterar los algoritmos morales de un coche debería estar penado por la ley, igual que lo es tomar el control de un coche de forma remota. Creedme, no será la última vez en los próximos años que hablemos de lo que podría convertirse en una barrera para la implantación del coche autónomo.

Quizá todo se resuma en la falsa sensación de seguridad que nos otorga el manejar un vehículo por nosotros mismos, frente a ceder el control a un tercero, en este caso un cerebro electrónico. Quizá por ello nos sentimos más seguros conduciendo un coche que viajando en un avión pilotado por un tercero, aunque estadísticamente, el avión sea mucho más seguro.

Fuente: CT

En Diariomotor: